Hầu như mọi dự án AI đều chạm đến cùng một điểm bẻ hướng. Một đội ngũ xác định được một use case đủ giá trị để xây dựng. Nhóm kỹ thuật muốn kết nối một LLM với tài liệu nội bộ, kết quả mô phỏng, thông số sản phẩm hoặc kho lưu trữ thiết kế để các chuyên gia nghiệp vụ có thể truy vấn chính dữ liệu của mình bằng ngôn ngữ tự nhiên. Mô hình đó chính là retrieval-augmented generation (RAG), và môi trường lý tưởng để xây dựng nó là một GPU virtua

l workstation. Ý tưởng thì hoàn toàn hợp lý. Nhưng rồi sẽ có người đặt ra câu hỏi khiến dự án chững lại: hạ tầng để chạy nó ở đâu?

Ngày càng nhiều tổ chức đang chuẩn hóa trên mô hình GPU virtual workstation. Đây không phải là các endpoint trên cloud tính phí theo giờ GPU. Cũng không phải môi trường notebook dùng chung nơi các nhóm phải tranh tài nguyên với nhau mỗi sáng. Mô hình ở đây là một máy ảo tự chứa, có tài nguyên GPU chuyên dụng, chạy trên hạ tầng mà đội IT vốn đã quản lý sẵn. Sáng kiến NVIDIA AI Virtual Workstation toolkit giúp điều này trở nên khả thi. Còn VergeOS làm cho lớp hạ tầng phía dưới gần như trở nên “vô hình”.

Những điểm chính cần nắm

NVIDIA RAG Application Toolkit cung cấp một lộ trình có hướng dẫn, có thể lặp lại, giúp đi từ một VM trắng tới một ứng dụng retrieval-augmented generation hoàn chỉnh bên trong GPU virtual workstation.

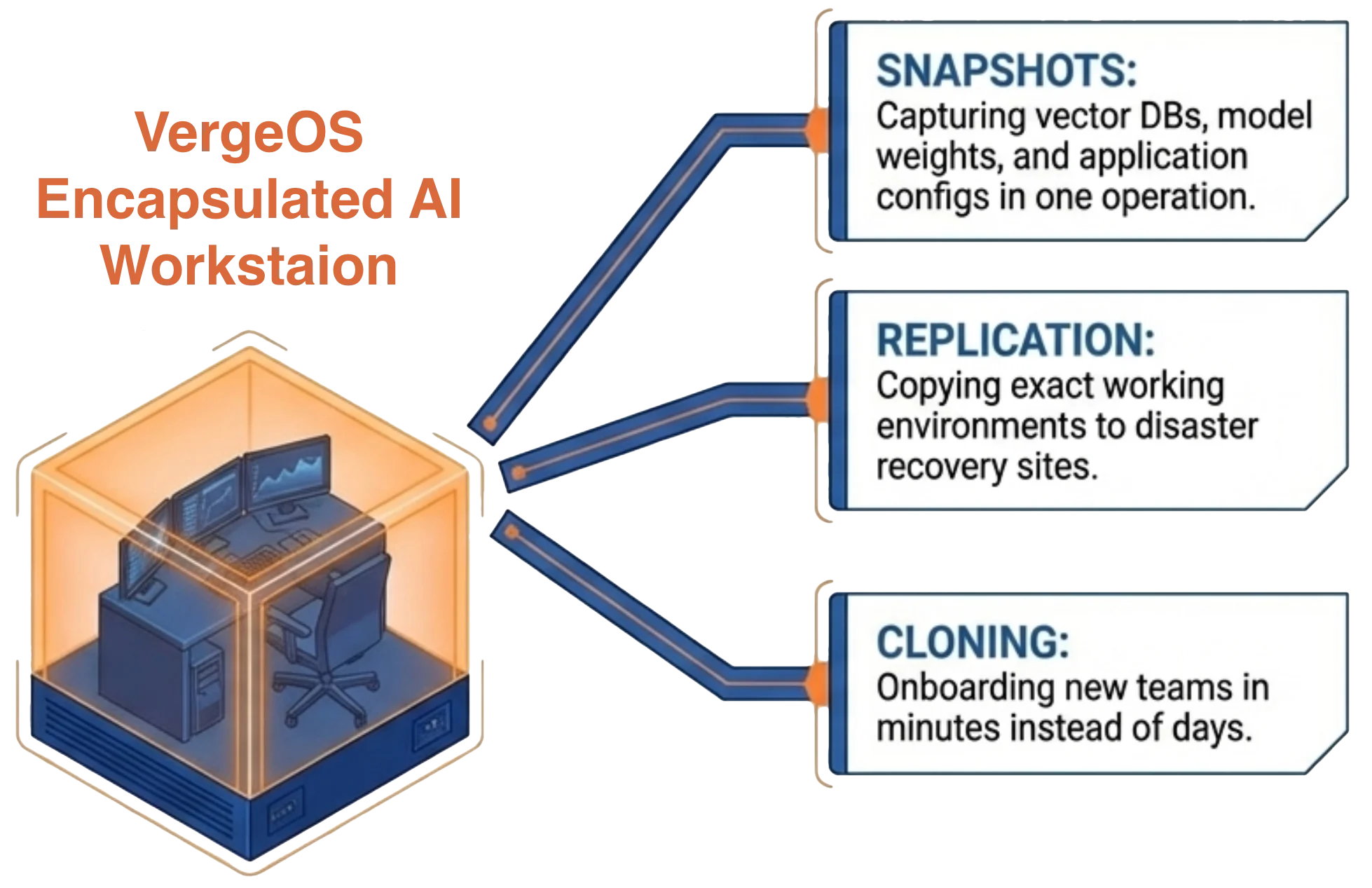

Các ứng dụng RAG chạy trong VM sẽ kế thừa đầy đủ tính kỷ luật hạ tầng như snapshot, replication, cloning và disaster recovery — những khả năng mà cách triển khai trên workstation vật lý thường không có.

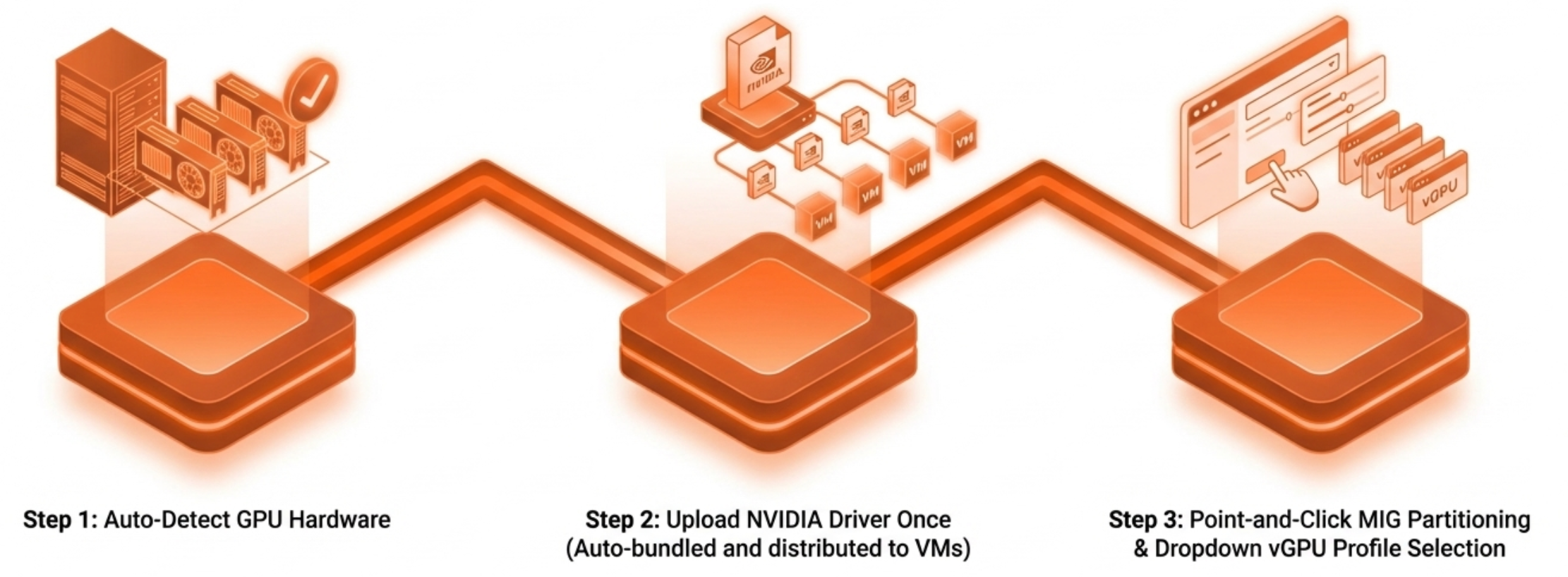

VergeOS rút gọn toàn bộ quy trình cấp phát GPU, triển khai driver, gán vGPU profile và phân vùng MIG thành một workflow point-and-click, không đòi hỏi chuyên gia GPU.

NVIDIA đã giới thiệu VergeOS như một nền tảng vGPU được hỗ trợ chính thức, từ đó thiết lập tuyến hỗ trợ chung để cả hai hãng cùng đứng sau quá trình triển khai.

RTX Pro 6000 Blackwell Server Edition hỗ trợ tối đa bốn môi trường RAG cách ly bằng MIG từ một GPU duy nhất, trong khi RTX 4500 cho phép lắp tới 16 card trong một chassis 4U cho các kịch bản ưu tiên mật độ triển khai.

Những tổ chức xây xong lớp hạ tầng GPU một lần sẽ có thể triển khai mọi bộ toolkit AI tiếp theo của NVIDIA như một dự án ứng dụng, thay vì lại phải bắt đầu từ một dự án hạ tầng mới.

Bộ toolkit đã thay đổi ý nghĩa của việc “bắt đầu”

NVIDIA ra mắt chương trình AI vWS toolkit khoảng một năm trước. Quan sát đứng sau sáng kiến này khá rõ ràng. Các GPU thế hệ mới dành cho data center và workstation, bao gồm cả các card dùng kiến trúc Blackwell, hiện đã có đủ dung lượng bộ nhớ và băng thông để chạy inference tăng tốc bằng GPU và phát triển AI ngay trong máy ảo. Những tiến bộ về quantization ở cấp framework và phần cứng cũng mở rộng đáng kể phạm vi những gì có thể nhét vừa trong một lần cấp phát vGPU. Mảnh ghép còn thiếu chưa bao giờ là phần cứng. Thứ còn thiếu là một lộ trình có hướng dẫn, giúp đi từ VM trắng đến ứng dụng chạy được.

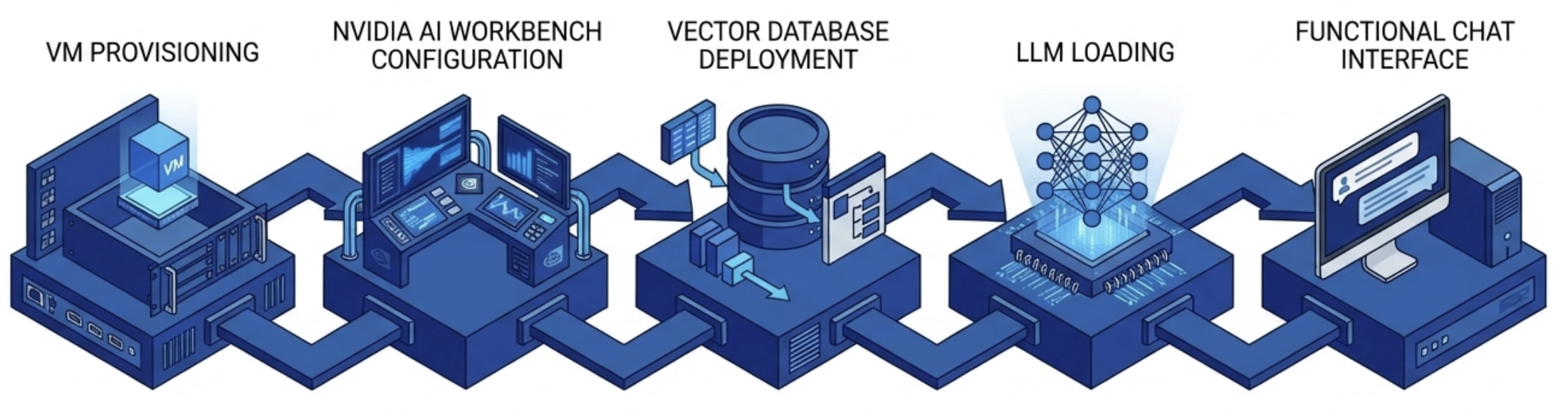

RAG Application Toolkit hiện là điểm vào phổ biến nhất. Nó dẫn dắt đội kỹ thuật hoặc data science qua toàn bộ quá trình triển khai trong GPU virtual workstation: provisioning VM, cấu hình NVIDIA AI Workbench, triển khai vector database, nạp LLM và dựng một giao diện chat có thể truy vấn dữ liệu của tổ chức. Cấu hình tối thiểu của VM khá vừa phải: 8 vCPU, 32 GB RAM hệ thống, 120 GB storage và một phần cấp phát vGPU.

Không có thành phần riêng lẻ nào trong số này là hoàn toàn mới. Vector database, embedding model và LLM inference đều là các công nghệ đã được hiểu khá rõ. Điểm đáng chú ý nằm ở chỗ NVIDIA đã ghép chúng thành một “công thức” có thể lặp lại và chạy ngay bên trong virtual workstation. Đây cũng chính là kiểu môi trường mà đội IT vốn đã quen trong việc provisioning, snapshot, replication và recovery. Và điểm cuối cùng đó quan trọng hơn nhiều so với cách phần lớn các cuộc thảo luận về AI thường thừa nhận.

Khoảng cách giữa AI prototype và production thực chất là bài toán hạ tầng

Khoảng cách giữa một AI prototype hoạt động được và một hệ thống sẵn sàng cho production gần như hoàn toàn là vấn đề của hạ tầng. Data scientist có thể tạo ra những kết quả ấn tượng trong notebook và môi trường cục bộ. Nhưng rồi sẽ có người phải biến thứ đó thành một hệ thống có thể phục hồi, có thể tái tạo và có thể quản trị ở cấp độ tổ chức.

Một ứng dụng RAG chạy trên workstation vật lý của developer không có chiến lược backup rõ ràng. Nó không có cơ chế replication. Nếu phần cứng hỏng, môi trường phải được dựng lại thủ công. Nếu một nhóm khác cần cùng cấu hình đó, toàn bộ quá trình cài đặt gần như phải được lặp lại từ đầu.

Ngược lại, một ứng dụng RAG chạy bên trong GPU virtual workstation sẽ thừa hưởng toàn bộ năng lực hạ tầng mà nền tảng cung cấp. Snapshot có thể chụp toàn bộ môi trường — vector database, model weights, cấu hình ứng dụng — chỉ trong một thao tác. Replication cho phép sao chép môi trường đang hoạt động sang site disaster recovery. Cloning VM giúp một thành viên mới có được cùng cấu hình trong vài phút thay vì vài ngày.

Đây không phải khác biệt mang tính lý thuyết. Nó là ranh giới giữa một sáng kiến AI chỉ tồn tại trên máy của một cá nhân và một năng lực AI thực sự vận hành như hạ tầng của tổ chức.

Nền tảng GPU Virtual Workstation là yếu tố quyết định

Bộ toolkit của NVIDIA giả định rằng một GPU virtual workstation đã tồn tại và hoạt động. Nó không quy định workstation đó được provisioning ra sao, tài nguyên GPU được cấp phát như thế nào, hay driver stack được quản lý ra sao. Tất cả những điều này là trách nhiệm của nền tảng hạ tầng.

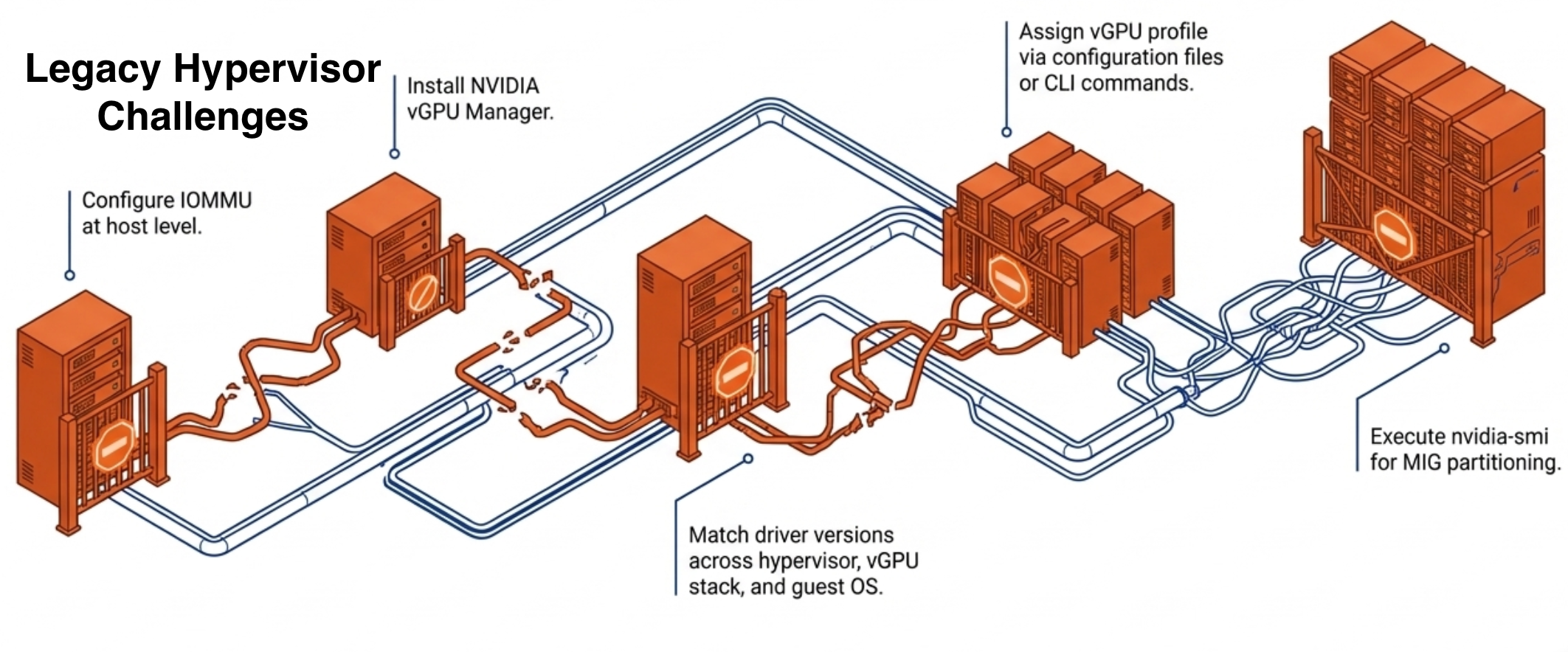

Trên nhiều hypervisor, việc dựng một GPU virtual workstation vẫn là một chuỗi thao tác thủ công dài dòng: cấu hình IOMMU ở cấp host, cài NVIDIA vGPU Manager, đồng bộ phiên bản driver giữa hypervisor, vGPU software stack và guest OS, rồi gán vGPU profile thông qua file cấu hình hoặc lệnh CLI.

Một số nền tảng đã cải thiện được một phần trải nghiệm này, nhưng phần lớn vẫn xem quản lý GPU là một bộ môn riêng biệt tách khỏi vận hành hạ tầng cốt lõi. Ngay cả việc phân vùng MIG — chia một GPU cao cấp thành nhiều instance cách ly ở cấp phần cứng để nhiều thành viên có thể làm việc đồng thời — trên đa số nền tảng vẫn đòi hỏi hiểu biết CLI với nvidia-smi.

VergeOS nén toàn bộ chuỗi thao tác đó thành một workflow mà một IT generalist cũng có thể hoàn tất mà không cần kiến thức chuyên sâu về GPU. Nền tảng tự phát hiện phần cứng GPU. Đội IT tải driver trực tiếp từ NVIDIA, khả dụng cho các khách hàng có NVIDIA vGPU software license hợp lệ, và chỉ cần upload một lần. VergeOS sẽ tự động đóng gói và phân phối driver đến VM khi được gán. vGPU profile được chọn từ menu dropdown. Phân vùng MIG chỉ cần point-and-click. GPU virtual workstation mà RAG toolkit giả định tồn tại có thể sẵn sàng trong vài phút thay vì vài ngày.

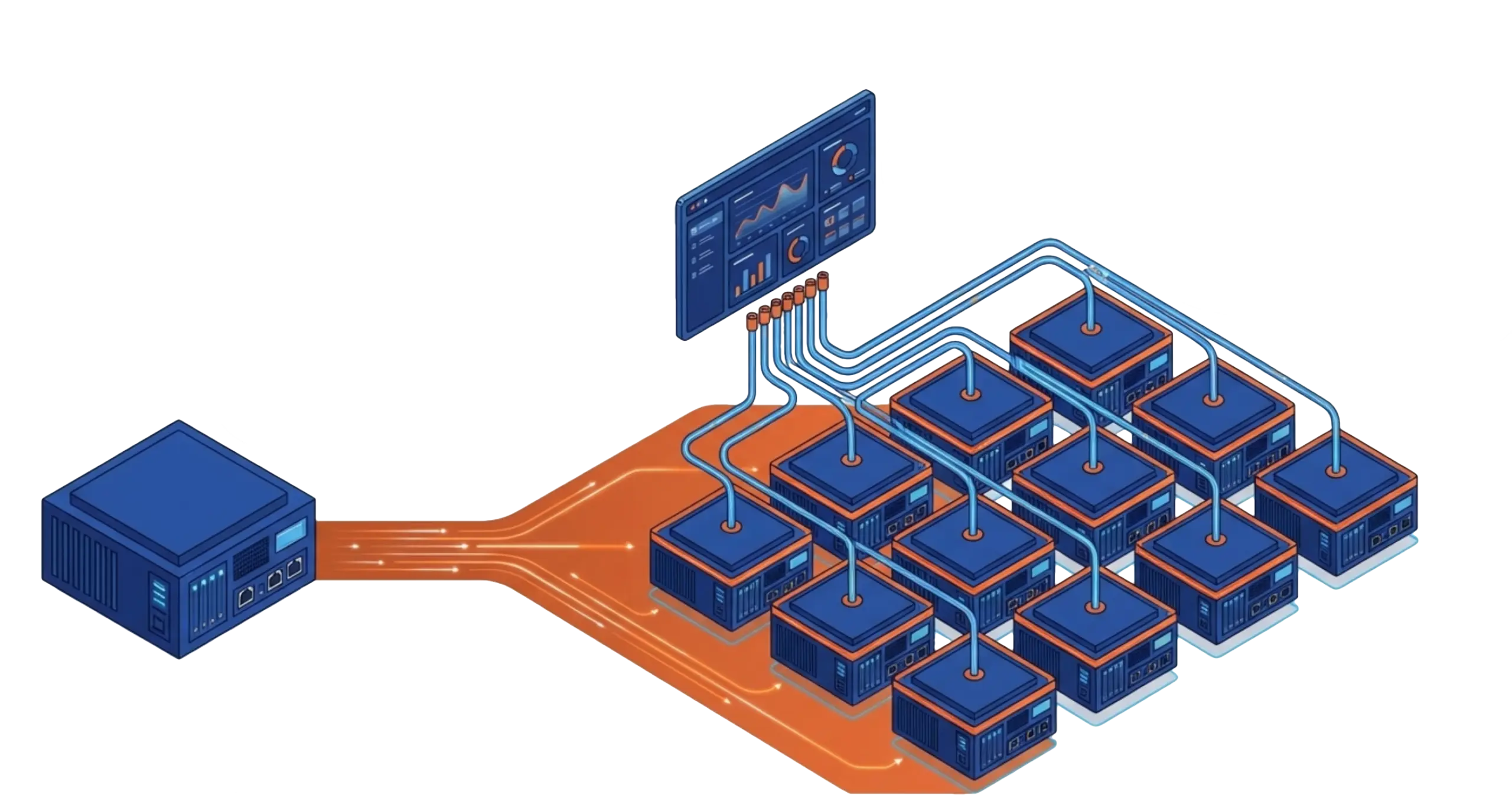

Sự khác biệt về vận hành càng rõ hơn khi scale. Một workstation RAG có thể chỉ là một dự án. Nhưng mười workstation RAG trải trên ba nhóm kỹ thuật, mỗi workstation có tài nguyên GPU cách ly, lịch snapshot và replication DR riêng, thì đó đã là một bài toán vận hành hạ tầng. VergeOS xử lý nó như một hệ thống thống nhất. Workload GPU được quản lý trong cùng giao diện với compute, storage và networking. Không cần một management plane riêng. Không cần một chuyên gia GPU trực ca. NVIDIA cũng đã đưa VergeOS vào danh sách nền tảng vGPU được hỗ trợ, đồng nghĩa cả hai vendor cùng chịu trách nhiệm hỗ trợ khi có sự cố.

Chọn cấu hình đúng cho GPU Virtual Workstation

Yêu cầu tối thiểu của RAG toolkit là 32 GB RAM hệ thống và một phần vGPU phù hợp, khá tương thích với các cấu hình phần cứng mà VergeOS đã xác thực. Với những nhóm muốn triển khai nhiều môi trường RAG từ cùng một card, một lựa chọn rất đáng chú ý là RTX Pro 6000 Blackwell Server Edition. Phân vùng MIG trên card này cho phép chia thành tối đa bốn instance cách ly ở cấp phần cứng, mỗi instance có bộ nhớ và tài nguyên compute riêng. Điều đó đồng nghĩa bốn nhóm data science có thể có bốn môi trường RAG độc lập chỉ từ một GPU duy nhất.

Với các tổ chức ưu tiên mật độ triển khai, RTX 4500 Blackwell Server Edition là một lựa chọn khác. Card này có thể lắp tới 16 chiếc trong một chassis 4U ở mức công suất 165 watt mỗi card. Mỗi card có 32 GB GDDR7 và Tensor Cores thế hệ thứ năm hỗ trợ FP4 inference. Tổ hợp này đủ sức xử lý workload RAG với khoảng trống hiệu năng cho các model lớn hơn và bộ sưu tập tài liệu lớn hơn khi use case dần mở rộng.

NVIDIA AI Sizing Advisor giúp các đội ngũ xác định cấu hình GPU virtual workstation phù hợp trước khi provision bất kỳ VM nào. Đây là một công cụ miễn phí, hoạt động theo dạng wizard chứ không phải chatbot, có thể khuyến nghị cấu hình dựa trên tham số workload cụ thể và kèm theo smoke test để xác nhận khuyến nghị trước khi triển khai.

Không chỉ là một dự án, mà là một mô hình

RAG toolkit là điểm vào dễ thấy nhất, nhưng nó đại diện cho một mô hình rộng hơn. Danh mục toolkit của NVIDIA còn bao gồm Agentic RAG cho các workflow truy xuất nhiều bước, một fine-tuning toolkit cho bài toán tùy biến model, và một toolkit về video search and summarization dự kiến ra mắt trong năm nay. Tất cả đều đi theo cùng một mô hình: một lộ trình triển khai có hướng dẫn, với giả định rằng một GPU virtual workstation đã sẵn sàng.

RAG toolkit là điểm vào dễ thấy nhất, nhưng nó đại diện cho một mô hình rộng hơn. Danh mục toolkit của NVIDIA còn bao gồm Agentic RAG cho các workflow truy xuất nhiều bước, một fine-tuning toolkit cho bài toán tùy biến model, và một toolkit về video search and summarization dự kiến ra mắt trong năm nay. Tất cả đều đi theo cùng một mô hình: một lộ trình triển khai có hướng dẫn, với giả định rằng một GPU virtual workstation đã sẵn sàng.

Những tổ chức xây xong lớp hạ tầng này một lần — từ GPU provisioning, quản lý driver, cấu hình MIG đến snapshot và workflow recovery — sẽ có thể triển khai các toolkit tiếp theo như những dự án ứng dụng đơn thuần thay vì lặp lại từ đầu như một dự án hạ tầng mới. Chính hạ tầng đang chạy engineering VDI, workload mô phỏng và scientific visualization cũng có thể mở rộng sang AI development mà không cần thêm một management stack thứ hai. Giá trị đầu tư vào nền tảng vì thế được cộng dồn theo thời gian.

VergeOS được thiết kế đúng cho mô hình này. Cùng một hạ tầng có thể chạy workstation RAG đầu tiên, workstation thứ mười, môi trường fine-tuning và cả inference endpoint. Một giao diện. Cùng một tập workflow vận hành. Không cần phải tăng thêm quy mô đội ngũ quản trị chỉ để theo kịp AI.

Kết luận

Điểm khó nhất trong việc bắt đầu với RAG không còn là model hay phần cứng GPU. Điều làm nhiều dự án dừng lại chính là lớp hạ tầng bên dưới: ai sẽ provision VM, ai quản driver, ai cấu hình vGPU, ai xử lý partitioning và ai biến một prototype thành một môi trường có thể backup, replicate và recover.

Điều mà NVIDIA RAG Application Toolkit thay đổi không chỉ là tốc độ bắt đầu, mà là cách tổ chức nhìn nhận toàn bộ quá trình này. Khi đã có một GPU virtual workstation được vận hành đúng cách, việc triển khai RAG không còn là bài toán dựng hạ tầng từ đầu. Nó trở thành một dự án ứng dụng có thể lặp lại, mở rộng và quản trị như bất kỳ dịch vụ CNTT nghiêm túc nào khác.

Và đó cũng là điểm then chốt. Trong giai đoạn AI đang chuyển từ thử nghiệm sang triển khai thực tế, tổ chức nào xây được lớp dữ liệu và lớp hạ tầng đủ kỷ luật một lần sẽ có lợi thế lâu dài hơn nhiều so với tổ chức chỉ tiếp tục chạy theo từng công cụ AI một cách rời rạc.

Unitas cam kết đồng hành cùng doanh nghiệp, cung cấp các giải pháp và phân tích an ninh mạng tiên tiến nhất. Để nhận được tư vấn chuyên sâu hoặc hỗ trợ nhanh chóng, vui lòng liên hệ với chúng tôi qua email: info@unitas.vn hoặc Hotline: (+84) 939 586 168.