Trong cuộc đua không ngừng nghỉ của đổi mới trí tuệ nhân tạo (AI), các Đối tác Đám mây NVIDIA (NVIDIA Cloud Partners – NCPs) đang giữ vai trò tiên phong, mang đến tài nguyên GPU hiệu năng cao cho khách hàng trên toàn cầu. Những cái tên như Vultr, CoreWeave, Nebius, Core42, Lambda và Crusoe đang định hình lại cách doanh nghiệp khai thác AI tạo sinh, mô hình ngôn ngữ lớn (LLM) và mô phỏng khoa học, thông qua các dịch vụ đám mây linh hoạt, theo nhu cầu.

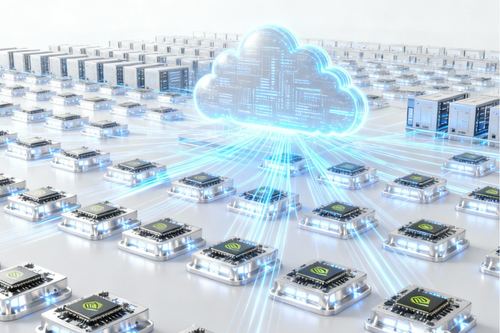

Tuy nhiên, khi các NCP mở rộng quy mô cung cấp dịch vụ, hạ tầng công nghệ của họ phải bắt kịp tốc độ bùng nổ của các khối lượng công việc thế hệ mới. Và đó là lúc kiến trúc NVIDIA Blackwell ra đời – một bước nhảy vọt trong tăng tốc GPU, với NVIDIA HGX B300 và NVIDIA GB300 NVL72. Hai “cỗ máy khổng lồ” này, được trang bị GPU Blackwell Ultra, mang đến hiệu năng chưa từng có: lên đến 144 PFLOPS FP4 và 72 PFLOPS FP8 trong hệ thống HGX B300, 2,1 TB bộ nhớ HBM3e mỗi rack, cùng khả năng exascale trong các rack GB300 NVL72 với 72 GPU Blackwell Ultra, 37 TB bộ nhớ nhanh và băng thông NVLink 130 TB/s, tất cả được tối ưu cho hiệu quả năng lượng vượt trội.

KHÔNG CHỈ LÀ SỨC MẠNH XỬ LÝ – LƯU TRỮ PHẢI “THEO KỊP” GPU BLACKWELL

Sức mạnh tính toán khổng lồ vẫn chưa đủ để đáp ứng nhu cầu của NCP. Để khai thác tối đa tiềm năng của Blackwell và đảm bảo hiệu suất liền mạch, hệ thống cần một giải pháp lưu trữ đủ nhanh để “nuôi” GPU hoạt động ở tốc độ tối đa, cung cấp băng thông hàng petabyte mà không gây tắc nghẽn, đồng thời hỗ trợ phân vùng đa người dùng, triển khai nhanh và mở rộng chi phí hiệu quả.

Hôm nay, DDN công bố hai Thiết kế Tham chiếu (Reference Designs) mới trong bộ DDN AI Factory Solutions (A3I) dành riêng cho các Đối tác Đám mây NVIDIA. Các thiết kế này hỗ trợ toàn diện các nền tảng NVIDIA HGX H200, B200, B300 và NVIDIA GB200 NVL72, GB300 NVL72, được tối ưu hóa cho triển khai Blackwell Ultra trong môi trường đám mây.

Nhờ vào kinh nghiệm triển khai thực tế, DDN đã tích hợp thiết bị lưu trữ AI400X3 cùng bộ phần mềm Insight với hệ thống B300 và GB300 NVL72, mang đến giải pháp đã được kiểm chứng ở quy mô toàn cầu – hơn 1 triệu GPU đang được vận hành – giúp các NCP như CoreWeave và Nebius cung cấp dịch vụ GPU cloud ổn định, đáng tin cậy cho khách hàng.

TẠI SAO BLACKWELL ULTRA GPU ĐỊNH NGHĨA LẠI AI TRÊN NỀN TẢNG ĐÁM MÂY

Kiến trúc NVIDIA Blackwell không chỉ là cải tiến – đó là một cuộc cách mạng. Được thiết kế riêng cho NCPs cung cấp dịch vụ GPU đám mây khác biệt, GPU B300 trong nền tảng HGX B300 mang lại hiệu năng vượt trội với 279 GB bộ nhớ HBM3e mỗi GPU, băng thông gấp đôi thế hệ trước (~8 TB/s) và hiệu suất FP4/INT8 được nâng cấp, sẵn sàng cho các tác vụ AI chuyên sâu.

Còn GB300 NVL72, với 72 GPU Blackwell Ultra và 36 CPU Grace, là “cỗ máy khổng lồ” được làm mát bằng chất lỏng và kết nối bằng NVLink, hướng đến các hệ thống AI quy mô siêu lớn, với 20 TB bộ nhớ GPU và băng thông 576 TB/s.

Đối với khách hàng của NCP, điều này mang lại:

- Tăng tốc khổng lồ về băng thông: Xử lý mô hình nghìn tỷ tham số trong thời gian thực, thu hút khách hàng AI cao cấp.

- Tối ưu năng lượng và không gian: Hiệu suất năng lượng vượt trội, giảm dấu chân carbon, tối đa doanh thu trên mỗi mét vuông trung tâm dữ liệu.

- Kết nối hợp nhất: NVLink 5.0 cung cấp băng thông 1,8 TB/s mỗi GPU, đòi hỏi hệ thống lưu trữ có thể truyền dữ liệu không độ trễ, đảm bảo SLA cho mọi workload.

DDN – TĂNG TỐC BLACKWELL ULTRA GPU Ở QUY MÔ EXASCALE

Thiết kế mới của DDN được đồng phát triển với NVIDIA, chứng nhận tương thích HGX, và kiểm thử trên nhiều mô hình đám mây khác nhau, giúp các NCP như Vultr và Core42 triển khai nhanh và phục vụ được nhiều khách hàng hơn.

Trung tâm của giải pháp là thiết bị DDN AI400X3, mang đến băng thông đọc hơn 1 TB/s mỗi thiết bị với khả năng mở rộng tuyến tính. Kết hợp với phần mềm Insight, giải pháp này cung cấp quản lý trực quan, phân tích dự đoán, và tích hợp liền mạch với NVIDIA AI Enterprise, Spectrum-X Ethernet, Quantum-2 InfiniBand, hỗ trợ tạo các vùng lưu trữ tách biệt cho từng khách hàng.

BẢN THIẾT KẾ ĐƯỢC CHỨNG NHẬN VÀ TỐI ƯU TRIỂN KHAI

DDN cung cấp các mô hình linh hoạt để hỗ trợ mọi giai đoạn phát triển của NCP:

- Cụm 1.024–1.152 GPU: Dành cho các nhà cung cấp mới thử nghiệm Blackwell, sử dụng kết nối đa đường (LACP bonding) để xử lý nhu cầu dữ liệu tăng đột biến.

- Vùng 16.000 GPU: Phù hợp cho doanh nghiệp lớn như Nebius, cân bằng giữa dung lượng (tới 100 PB) và độ sẵn sàng 99,999%.

- Triển khai siêu quy mô 40.000+ GPU: Dành cho những “ông lớn” như CoreWeave, xử lý dữ liệu ở cấp exabyte, với tối ưu hóa NUMA và caching thông minh.

TỐI ƯU TỪ ĐẦU ĐẾN CUỐI – GIỮ BLACKWELL HOẠT ĐỘNG Ở HIỆU SUẤT TỐI ĐA

Điểm nổi bật khiến DDN AI400X3 khác biệt chính là tích hợp sâu với NVIDIA, loại bỏ tắc nghẽn trong luồng công việc và giúp onboarding khách hàng nhanh hơn:

- Kiến trúc song song chia sẻ: Dữ liệu truyền tốc độ cao, độ trễ thấp, không còn tình trạng GPU “đói dữ liệu”.

- Pipeline học sâu liền mạch: Hỗ trợ thực thi song song các giai đoạn ingest – train – checkpoint, tăng tốc quy trình đào tạo mạng neuron gấp 5 lần.

- Mạng đa đường và LACP Bonding: Tăng băng thông tổng lên đến 800 Gb/s mỗi node, đảm bảo độ ổn định cho dịch vụ đa thuê.

- Caching thông minh & tối ưu I/O: Giảm độ trễ, tăng tốc checkpointing 15 lần, giảm tải lưu trữ chia sẻ và chi phí vận hành.

- Quản lý thông minh dựa trên dữ liệu: Theo dõi cache, dự đoán nhu cầu, tối ưu ROI theo thời gian thực.

Các thử nghiệm cho thấy hệ thống này giúp tăng 15 lần tốc độ phục hồi, đạt hiệu suất GPU tới 99%, biến khoản đầu tư Blackwell thành động cơ lợi nhuận thực sự.

BLACKWELL + DDN AI400X3: MỞ RỘNG, BỀN VỮNG VÀ SẴN SÀNG CHO TƯƠNG LAI

Nâng cấp lên NVIDIA Blackwell không chỉ là cuộc đua về tốc độ – mà là bước tiến để xây dựng đám mây không giới hạn, phục vụ nhiều khách hàng hơn với chi phí vận hành thấp hơn (TCO).

Các thiết kế DDN AI Factory cho phép mở rộng linh hoạt, từ quy mô rack đến đa vùng, mà không cần thay đổi nền tảng. Hiệu quả năng lượng cao, triển khai nhanh, tối đa hóa ROI – tất cả nhằm đảm bảo mọi GPU Blackwell hoạt động ở công suất tối đa.

Được tin cậy trong các dự án trọng điểm của NVIDIA và nay được tùy chỉnh riêng cho NCPs như Vultr, CoreWeave, Nebius, Core42, các bản thiết kế này mang công nghệ siêu máy tính đến môi trường đám mây, sẵn sàng cho hành trình Blackwell và dịch vụ AI lấy khách hàng làm trung tâm.

Sẵn sàng nâng cấp hạ tầng NVIDIA Cloud của bạn? Dù bạn đang triển khai hệ thống B300 HGX mới hay mở rộng với GB300 NVL72, đội ngũ chuyên gia DDN sẽ đồng hành cùng bạn để thiết kế, tối ưu và mở rộng quy mô.

Hãy liên hệ ngay hôm nay để nhận bản thiết kế đầy đủ, lên lịch tư vấn chuyên sâu, và cùng nhau xây dựng đám mây AI của tương lai.

Unitas cam kết đồng hành cùng doanh nghiệp, cung cấp các giải pháp và phân tích an ninh mạng tiên tiến nhất. Để nhận được tư vấn chuyên sâu hoặc hỗ trợ nhanh chóng, vui lòng liên hệ với chúng tôi qua email: info@unitas.vn hoặc Hotline: (+84) 939 586 168.